Știri

Știri din categoria Inteligență artificială

Apple a prezentat Ferret-UI Lite, un model AI compact care poate naviga autonom în aplicații direct pe dispozitiv, fără a trimite date în cloud, potrivit lucrării publicate pe arXiv. Modelul are 3 miliarde de parametri, dar, susțin autorii, egalează sau depășește performanța unor agenți pentru interfețe grafice de până la 24 de ori mai mari.

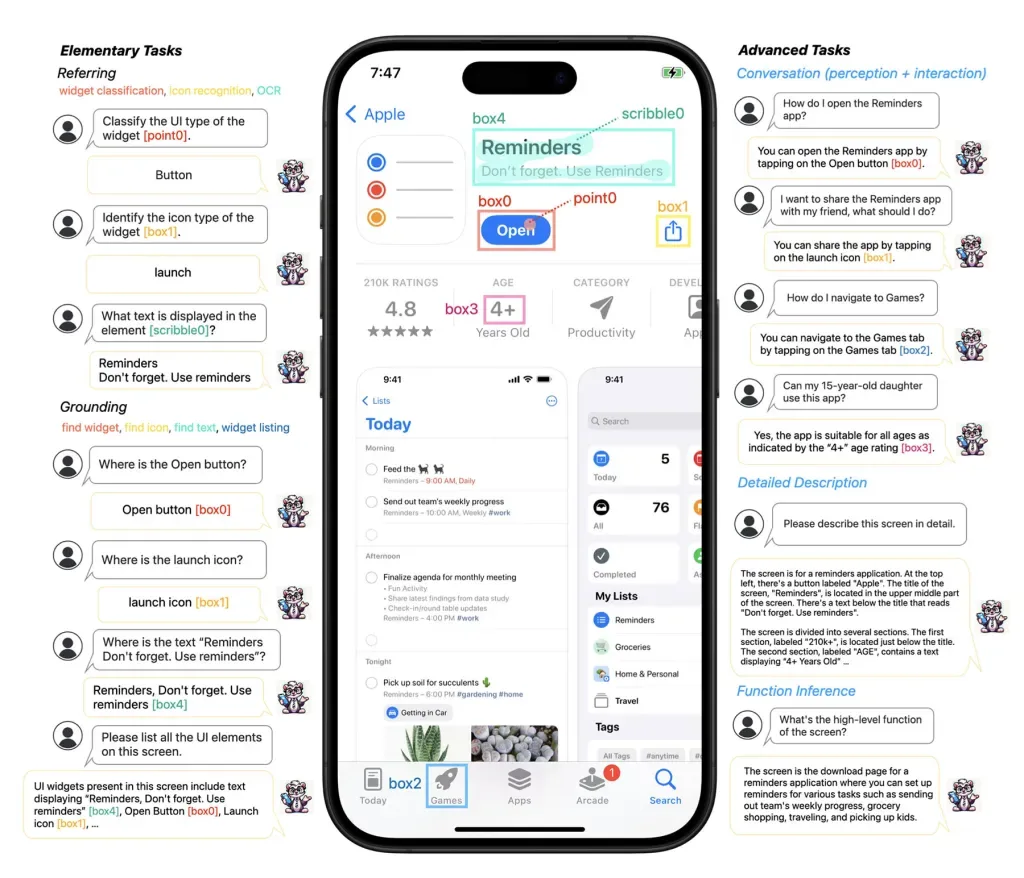

Ferret-UI Lite este un model multimodal conceput pentru a înțelege și a interacționa cu interfețe de aplicații mobile, web și desktop. Scopul este rularea integrală pe dispozitiv, ceea ce ar permite asistenților virtuali să execute sarcini în numele utilizatorului fără ca informațiile sensibile să părăsească telefonul sau calculatorul.

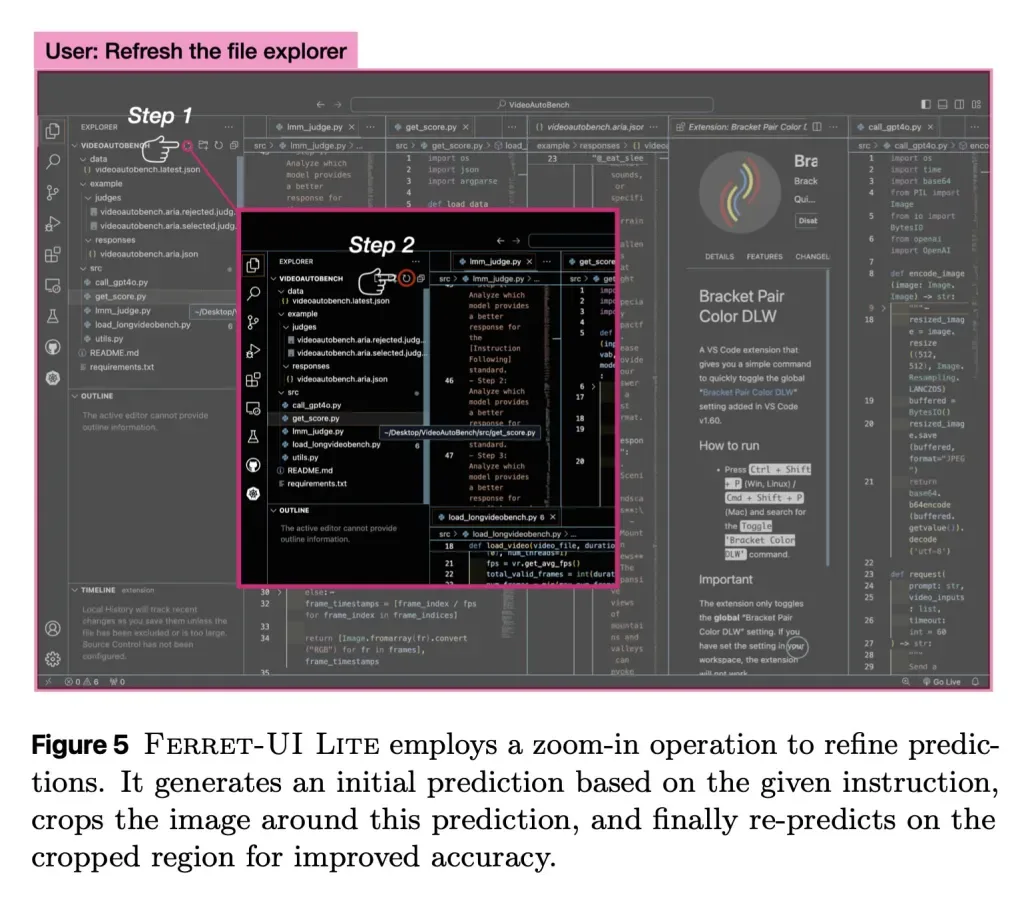

Principala dificultate pentru modelele mici este interpretarea elementelor dense și de dimensiuni reduse de pe ecran. Apple a introdus o tehnică numită „decupare în faza de inferență”, care presupune două etape:

Antrenarea a fost realizată și cu ajutorul unui sistem sintetic, bazat pe patru roluri simulate – generator de sarcini, planificator, executor și critic – care reproduc interacțiuni reale, inclusiv erori precum atingeri nereușite sau ferestre pop-up neașteptate. Astfel, modelul a fost învățat să corecteze greșeli și să își continue sarcina.

Conform datelor prezentate în lucrare:

Pe ScreenSpot-Pro, modelul a depășit alți agenți de 3 miliarde de parametri cu peste 15 puncte procentuale.

Publicarea cercetării vine în contextul pregătirii unei versiuni modernizate a asistentului Siri, așteptată în primăvara lui 2026, odată cu iOS 26.4. Un model capabil să „citească” și să opereze aplicații local ar putea sta la baza unor funcții avansate, precum executarea de sarcini complexe în mai multe aplicații consecutive.

Apple subliniază avantajul confidențialității: rularea pe dispozitiv ar însemna că mesaje, date financiare sau informații medicale nu sunt transmise către servere externe.

Autorii recunosc că modelul performează mai bine în sarcini scurte și directe și întâmpină dificultăți în operațiuni complexe, cu mai mulți pași. Deocamdată, nu există confirmarea integrării Ferret-UI Lite într-un produs comercial, însă direcția cercetării indică intenția Apple de a dezvolta agenți AI eficienți și orientați spre protecția datelor.

Recomandate

Apple își pregătește relansarea „Apple Intelligence” și Siri în 2026 fără să relaxeze standardele de confidențialitate , potrivit AppleInsider , într-un moment în care presiunea publică și de reglementare pe modul în care sunt folosite datele pentru antrenarea modelelor de inteligență artificială crește. Mesajul-cheie: compania pariază că poate recupera întârzierea în AI fără să facă compromisuri pe „privacy” (protecția vieții private) și securitatea datelor. AppleInsider scrie că Apple ar urma să relanseze platformele Apple Intelligence și Siri cu noi „Apple Foundation Models” (modele de bază, folosite ca infrastructură pentru funcții AI). În același timp, publicația notează că, deși există implicarea Google în ecuație, Apple nu ar intenționa să-și schimbe poziția tradițională privind confidențialitatea utilizatorilor. Ce se schimbă operațional: relansare în 2026, după întârzieri Contextul pornește de la prezentarea Apple Intelligence la WWDC 2024 , când Apple ar fi avut un sistem „hibrid” care, în final, „nu a livrat”, iar apoi au urmat întârzieri. Materialul indică faptul că „așteptarea lungă” pentru strategia AI „adevărată” a Apple ar fi pe cale să se încheie, cu WWDC 2026 văzut ca moment de referință pentru direcția pe următorul an. Totuși, articolul subliniază și o limitare importantă: nu apar „detalii noi” despre eforturile Apple pe AI, ci mai degrabă o recapitulare a informațiilor deja cunoscute și o interpretare a poziționării companiei. De ce contează: AI cu „garduri” de confidențialitate, într-o piață tot mai contestată AppleInsider leagă strategia Apple de nemulțumirea tot mai vizibilă față de costurile dezvoltării AI: folosirea pe scară largă a datelor, efecte asupra piețelor financiare, disponibilității componentelor și asupra mediului. În acest cadru, Apple mizează pe diferențiere printr-o abordare care nu „sacrifică” confidențialitatea pentru demonstrații spectaculoase, dar cu utilitate limitată în viața reală. Publicația face trimitere și la newsletterul „Power On” al Bloomberg, care ar susține că Apple nu va compromite confidențialitatea în noile sale eforturi de AI, deși raportarea ar fi „colorată” de presupuneri despre ce urmează. Relația cu Google: fără indicii că Apple își înlocuiește modelele În privința colaborării cu Google (menționată în contextul Gemini), AppleInsider notează că WWDC 2026 ar putea aduce mai multă lumină asupra planurilor Apple, dar nu neapărat „detalii explicite” despre modul de lucru cu Google Gemini. Mesajul transmis este că Apple nu își va înlocui propriile modele cu Gemini, cel puțin pe baza informațiilor discutate în material. În lipsa unor specificații tehnice sau a unui calendar detaliat în sursă, rămâne de urmărit ce anume va prezenta Apple la WWDC 2026 și cum va traduce, practic, promisiunea de AI „cu confidențialitate” în funcții și produse. [...]

O posibilă ruptură între OpenAI și Apple ar putea schimba concret experiența de inteligență artificială pe iPhone , inclusiv prin limitarea sau chiar eliminarea accesului la ChatGPT din iOS, potrivit TechRadar , care citează un material Bloomberg despre tensiunile din parteneriatul legat de Apple Intelligence și Siri. Conform Bloomberg, OpenAI ar fi tot mai frustrată de modul în care integrarea ChatGPT a fost implementată în ecosistemul Apple și ar lua în calcul opțiuni legale, inclusiv o notificare de încălcare a contractului (fără a depune neapărat imediat un proces). În paralel, Apple ar avea propriile nemulțumiri, inclusiv legate de confidențialitatea utilizatorilor și de planurile OpenAI de a intra pe zona de hardware. Ce ar putea însemna pentru utilizatorii de iPhone Miza operațională este că, dacă disputa se adâncește și nu se ajunge la o înțelegere, Apple ar putea să-și schimbe prioritățile privind furnizorii de „chatbot” (asistenți conversaționali) integrați în iOS. Scenariile menționate includ: Apple ar putea începe să favorizeze alte modele, precum Gemini (Google) sau Claude (Anthropic), în detrimentul ChatGPT; în cazul unui eșec al colaborării, Apple ar putea elimina complet instrumentul OpenAI de pe iPhone, ceea ce ar duce la o experiență de inteligență artificială diferită pe iOS. În prezent, una dintre nemulțumirile OpenAI ar fi că ChatGPT este disponibil doar în câteva zone din iOS și, adesea, trebuie invocat explicit prin cuvântul „ChatGPT”, ceea ce îl face mai puțin vizibil pentru utilizatori și, implicit, mai puțin eficient ca motor de conversie către abonamente, potrivit Bloomberg. De unde vine conflictul: integrare, distribuție și așteptări Bloomberg notează că OpenAI ar fi mizat pe două beneficii principale din parteneriat: atragerea de abonați prin expunerea în ecosistemul Apple și o integrare mai profundă, inclusiv „plasare” mai bună în Siri și în mai multe aplicații Apple. Aceste așteptări nu s-ar fi materializat în forma anticipată. Pe de altă parte, Apple ar fi îngrijorată de angajamentul OpenAI față de confidențialitatea utilizatorilor (un element central în poziționarea Apple) și ar fi iritată de intențiile OpenAI de a dezvolta hardware, mai ales în contextul implicării fostului șef de design Apple, Jony Ive, și al recrutărilor din Apple. Bloomberg citează un executiv OpenAI (nemenționat) care susține că OpenAI și-a făcut partea „din perspectiva produsului” și acuză Apple că „nici măcar nu a făcut un efort cinstit”. Ce nu se știe încă și la ce să ne așteptăm Un detaliu important care lipsește, potrivit materialului, este baza juridică exactă: nu este clar ce clauze ar fi fost încălcate și nici dacă Apple ar fi încălcat efectiv contractul. De asemenea, Bloomberg precizează că planurile Apple de a deschide iOS către mai mulți furnizori de chatboți nu ar fi, în sine, cauza conflictului, întrucât parteneriatul cu OpenAI „nu ar fi fost gândit ca exclusiv” de la început. Pe termen scurt, implicația practică pentru utilizatori este incertitudinea: dacă tensiunile se traduc în schimbări de produs, acestea ar putea apărea ca modificări de integrare în Siri/Apple Intelligence sau ca o reorientare către alți furnizori de asistenți conversaționali. În acest moment, rămâne neclar dacă disputa va escalada într-un proces sau va fi gestionată printr-o renegociere. [...]

Huiduielile la discursul lui Eric Schmidt scot în față anxietatea privind joburile în era AI , într-un moment în care companiile mari accelerează dezvoltarea inteligenței artificiale, iar dezbaterea despre efectele în economie se mută tot mai des în spațiul public, potrivit Mediafax . Incidentul a avut loc duminică, la ceremonia de absolvire a University of Arizona , în fața promoției 2026. Eric Schmidt, fost director executiv al Google, a fost huiduit de mai multe ori în timpul intervenției, relatează NBC News, citată de Mediafax. De ce contează: frica de înlocuire a locurilor de muncă intră în prim-plan Momentul tensionat este prezentat ca un semn al neliniștilor unei generații care vede ascensiunea AI drept o amenințare pentru locurile de muncă și pentru viitorul economic. Reacțiile au escaladat când Schmidt a comparat impactul inteligenței artificiale cu transformarea produsă de computerul personal. În discurs, Schmidt a recunoscut explicit temerile legate de piața muncii și de direcția societății: „Există o frică în generația voastră că viitorul a fost deja scris, că mașinile vin, că locurile de muncă dispar, că clima se degradează și că moșteniți o lume pe care nu voi ați creat-o.” El a susținut, totodată, că „viitorul nu este decis” și că generația actuală poate influența felul în care AI va fi dezvoltată și folosită. Context: universitatea îl apără, iar episoadele similare se repetă în SUA Universitatea a transmis ulterior că l-a invitat pe Schmidt pentru contribuțiile sale în tehnologie și cercetare, menționând rolul său în transformarea Google într-una dintre cele mai influente companii tehnologice și implicarea în inițiative științifice și educaționale. Potrivit materialului, reacțiile ostile la discursuri despre AI nu sunt izolate: în ultimele luni, mai multe ceremonii universitare din SUA au avut momente similare. La începutul lunii mai, o vorbitoare invitată la University of Central Florida a fost huiduită după ce a descris AI drept „următoarea revoluție industrială”. [...]

YouTube extinde la toți adulții un instrument care poate declanșa eliminarea deepfake-urilor cu fața ta , o schimbare operațională care mută protecția „anti-impersonare” din zona creatorilor și a persoanelor publice către utilizatorul obișnuit, potrivit The Verge . Funcția, numită „likeness detection” (detecția asemănării), folosește o scanare de tip selfie a feței pentru a căuta pe YouTube videoclipuri cu potriviri faciale. Dacă sistemul găsește o potrivire, utilizatorul este alertat și poate cere platformei să elimine conținutul. Ce se schimbă: acces pentru oricine are 18+ și cont YouTube YouTube a testat inițial instrumentul cu creatori de conținut, apoi l-a extins către oficiali guvernamentali, politicieni, jurnaliști și, ulterior, către industria de divertisment. Extinderea la „orice utilizator de 18 ani sau mai mult” este, conform publicației, un pas major: practic, oricine poate solicita monitorizarea continuă a platformei pentru posibile deepfake-uri care îi folosesc chipul. Un purtător de cuvânt al YouTube, Jack Malon , a precizat că nu există cerințe privind ce înseamnă „creator” pentru eligibilitate și a argumentat că protecția ar trebui să fie aceeași indiferent de vechimea pe platformă. „Prin această extindere, clarificăm că, indiferent dacă creatorii încarcă pe YouTube de un deceniu sau abia încep, vor avea acces la același nivel de protecție”, a transmis Malon într-un e-mail. Cum sunt evaluate cererile de eliminare și care sunt limitele Cererile de eliminare sunt analizate în baza politicii de confidențialitate a YouTube . Compania spune că ia în calcul criterii precum: dacă materialul este realist; dacă este etichetat ca fiind generat cu ajutorul inteligenței artificiale; dacă persoana poate fi identificată în mod unic. Există excepții pentru parodie sau satiră. În plus, instrumentul acoperă doar asemănarea facială, nu și alte elemente de identificare, precum vocea. Utilizatorii se pot retrage din program, iar YouTube afirmă că poate șterge datele asociate. Platforma a mai spus anterior că numărul cererilor de eliminare identificate prin acest program a fost „foarte mic”, fără a oferi cifre în materialul citat. De ce contează pentru utilizatorul obișnuit Deși deepfake-urile vizează frecvent celebrități și politicieni, riscul se extinde și la persoane private. The Verge amintește cazuri în care adolescenți au fost „deepfăcuți” de colegi și menționează un proces intentat de trei adolescenți împotriva xAI, care susțin că chatbotul Grok ar fi generat materiale de abuz sexual asupra copiilor (CSAM) cu ei. Pentru YouTube, extinderea instrumentului înseamnă și o creștere potențială a volumului de sesizări și a complexității moderării, într-un context în care platformele sunt presate să gestioneze mai strict conținutul generat de inteligența artificială. [...]

Google pregătește „Gemini Spark”, un agent de inteligență artificială pentru telefoane, care ar putea automatiza sarcini direct pe dispozitiv , potrivit Android Headlines , înaintea conferinței I/O 2026. Miza operațională este trecerea de la un asistent care răspunde la întrebări la unul care execută acțiuni în numele utilizatorului, cu impact direct asupra modului în care sunt folosite aplicațiile pe Android . Informațiile apar ca „scurgere” (leak), ceea ce înseamnă că detaliile pot suferi modificări până la o eventuală prezentare oficială și nu există, în acest stadiu, o confirmare publică din partea Google. Ce ar însemna „agentul” în utilizarea de zi cu zi Din perspectiva utilizatorului, un „agent” AI este un sistem care nu doar generează text, ci poate planifica și duce la capăt pași multipli pentru o sarcină (de exemplu, să caute informații, să compare opțiuni și să finalizeze o acțiune), în funcție de permisiunile primite. Potrivit publicației, „Gemini Spark” ar fi gândit pentru telefoane, ceea ce sugerează o integrare mai strânsă cu Android și cu aplicațiile uzuale. Dacă direcția se confirmă, schimbarea ar putea muta o parte din interacțiunile curente (căutare, organizare, completare de formulare, rezervări) către fluxuri automatizate, inițiate prin comenzi naturale. De ce contează pentru ecosistemul Android Un astfel de agent ar putea deveni un nou „strat” de interfață între utilizator și aplicații: în loc să navighezi manual prin mai multe ecrane, ai delega execuția către AI. Pentru dezvoltatori și companii, asta poate însemna presiune pentru: integrare mai bună cu mecanismele de automatizare și permisiuni din Android; adaptarea aplicațiilor la scenarii în care acțiunile sunt inițiate de un agent, nu direct de utilizator; clarificări privind controlul, trasabilitatea și securitatea acțiunilor făcute „în numele” utilizatorului. Ce urmează În lipsa unei confirmări oficiale, rămâne de văzut dacă Google va prezenta „Gemini Spark” la I/O 2026 și în ce formă: funcție separată, parte din Gemini sau integrată în Android. Până atunci, informațiile trebuie tratate ca preliminare, iar detaliile despre capabilități și disponibilitate pot fi diferite la lansare. [...]

Adoptarea inteligenței artificiale ar putea deveni un diferențiator de productivitate între companiile europene , iar ritmul de implementare va conta la fel de mult ca investițiile, a avertizat Mario Draghi la Timișoara, potrivit G4Media . Fostul președinte al Băncii Centrale Europene a spus că primele studii indică deja un efect pozitiv al AI asupra productivității, însă întrebarea-cheie rămâne cât de repede va ajunge tehnologia să fie folosită pe scară largă în economie. Draghi, invitat special la conferința Tech Talks organizată de Universitatea Politehnica Timișoara , a discutat cu jurnalistul CNN Richard Quest despre modul în care Europa poate rămâne relevantă într-un context accelerat de inteligența artificială, dar și despre crizele recente și capacitatea instituțiilor de a reacționa. Ce arată datele invocate de Draghi despre AI și productivitate Fostul premier italian a indicat câteva cifre care sugerează că adoptarea AI a început să se vadă în performanța companiilor: 36% dintre companiile europene adoptă deja AI , procent pe care Draghi l-a descris drept „surprinzător” de mare; în SUA, procentul depășește 50% ; productivitatea companiilor care folosesc AI crește cu aproximativ 4% , potrivit datelor citate de el; un studiu OECD arată că 50% din creșterea productivității până în 2030 se va datora adoptării inteligenței artificiale. „Inteligența artificială va ajuta la creșterea productivității. Primele studii arată că acest lucru se întâmplă deja atât în Europa, cât și în SUA. Întrebarea cea mai importantă este cât timp va dura până când AI-ul va fi adoptat de toate companiile.” De ce leagă Draghi AI de reforme mai rapide în Europa În intervenția sa, Draghi a conectat direct presiunea tehnologică de nevoia de reforme accelerate la nivel european. Întrebat despre progresele de după publicarea „Raportului Draghi” (realizat pentru Comisia Europeană), el a spus că există pași înainte, dar că „lumea se mișcă acum mult mai repede”, iar schimbările din comerțul internațional, relația cu SUA și dezvoltarea AI cer un ritm mai alert. „Concluzia raportului este clară: trebuie să acționăm acum, altfel riscăm să rămânem în urmă.” Un punct distinct a fost critica la adresa procesului decizional european, descris ca lent și încărcat de etape, cu trimitere la nevoia de reducere a birocrației și de clarificare a responsabilității pentru implementarea deciziilor. Context: criza energetică, inflația și reacția băncilor centrale Draghi a vorbit și despre criza energetică și inflație, comparând situația actuală cu anii ’70, dar subliniind că Europa este astăzi mai pregătită (inclusiv prin existența monedei euro și prin lecțiile învățate în politica monetară). Totuși, el a criticat reacția „extrem de lentă” a băncilor centrale la inflația din 2022–2023 și a pus în context perioada post-pandemie, marcată de cheltuieli mari și lichiditate ridicată în economie, la care s-au adăugat costurile războiului și creșterea deficitelor, inclusiv în Europa. În același dialog, Draghi a remarcat și diferența structurală dintre SUA și Europa, menționând că Statele Unite sunt exportator de energie. Ce urmează, în logica mesajului lui Draghi Mesajul central a fost că avantajul economic al AI nu va veni automat: contează viteza de adoptare în companii și capacitatea Europei de a lua și implementa decizii mai rapid. În lipsa accelerării reformelor, riscul, în formularea lui Draghi, este ca Europa să rămână în urmă într-o competiție în care tehnologia comprimă termenele de reacție. [...]